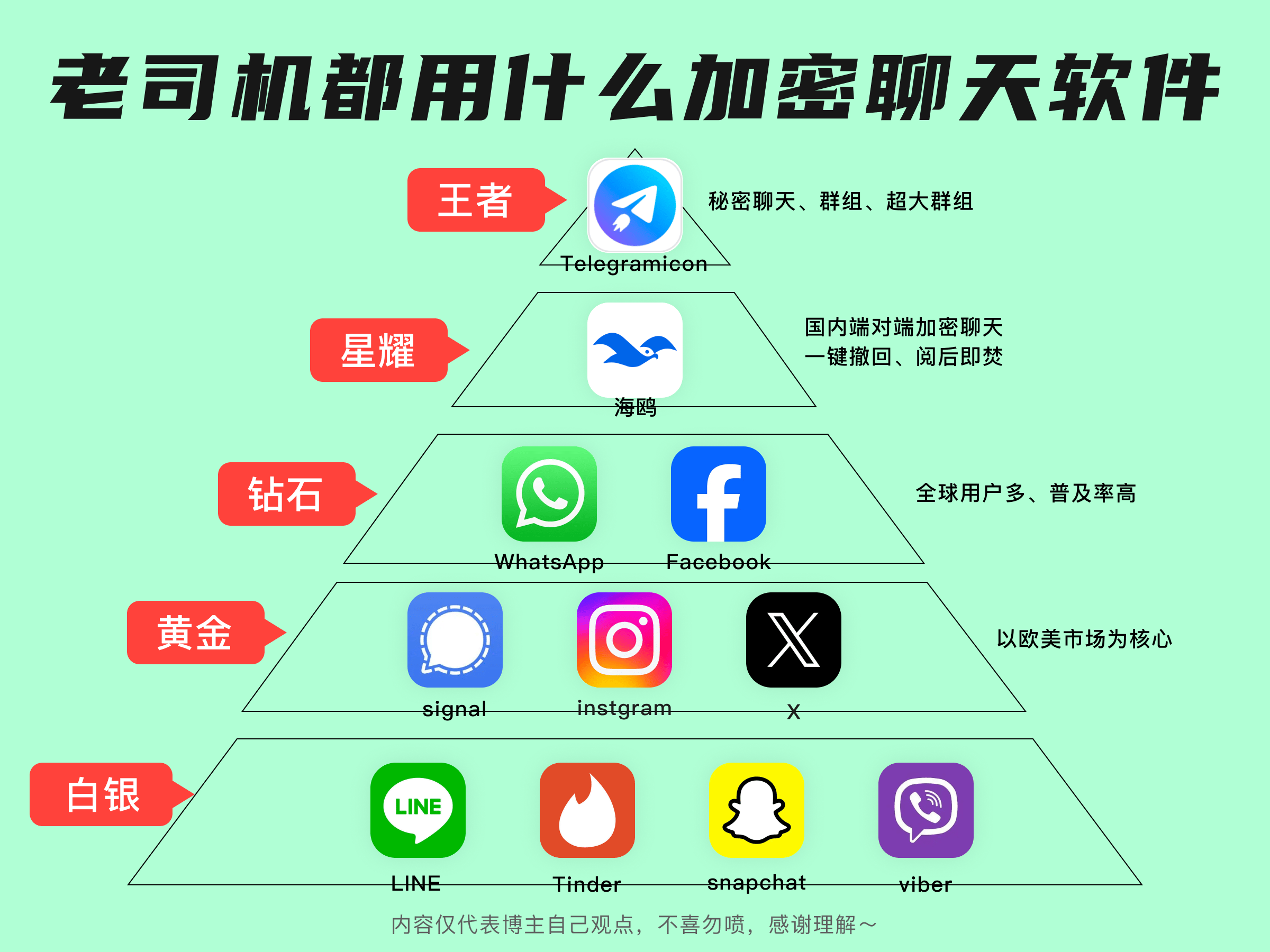

社工机器人:Telegram上的自动化社交工程工具

在数字时代,社交工程(Social Engineering)作为一种利用人性弱点获取信息的手段,已逐渐与自动化技术结合。Telegram作为一款注重隐私和开放机器人的即时通讯应用,成为了这类工具滋生的平台之一。社工机器人(OSINT或社工工具机器人)在Telegram上悄然兴起,它们以自动化服务的形式,为用户提供个人信息搜集、数据关联分析等功能,同时也引发了严重的隐私与伦理争议。 这些机器人通常由第三方开发者创建,通过Telegram的Bot API实现。用户只需输入特定指令,如电话号码、用户名或邮箱地址,机器人便能从公开或半公开的网络源(如社交媒体、数据泄露库)中爬取关联信息。例如,某些机器人可以返回目标在多个平台上的账户资料、历史记录甚至地理位置数据。这种“一站式”信息聚合,极大降低了传统社工的技术门槛,使非专业人士也能进行深度数据挖掘。 Telegram的生态系统为这类机器人提供了便利。其端到端加密和匿名性吸引了注重隐私的用户,但同时也为机器人运营者提供了隐蔽的操作环境。许多社工机器人以免费或付费订阅模式运行,在加密聊天中规避监管。尽管Telegram官方政策禁止滥用行为,但平台的分布式特性使得彻底清查变得困难。此外,部分机器人声称仅用于“安全研究”或“个人数据审计”,模糊了合法使用与恶意用途的界限。 社工机器人的泛滥带来了多重风险。对个人而言,它可能导致隐私全面泄露、网络骚扰或身份盗窃;对社会而言,这类工具可能被用于针对性攻击、商业间谍活动甚至政治操纵。更令人担忧的是,它们助长了网络空间的信任危机——当任何人都能轻易获取他人数字足迹时,社交互动的基础将受到侵蚀。安全专家警告,即使公开信息,经聚合分析后也可能暴露敏感模式,成为社会工程攻击的弹药。 面对这一挑战,监管与技术防护需双管齐下。用户应提高数字素养,谨慎分享个人信息,并定期检查隐私设置。平台方如Telegram需加强机器人审核,建立滥用举报机制。法律层面则需明确数据聚合工具的边界,平衡创新与伦理。毕竟,技术本身无善恶,但人性的抉择将决定它照亮黑暗还是窥探深渊。在数字阴影蔓延的今天,守护隐私已成为一场需要全民参与的持久战。